TikTokの「懂车帝」が作ったこの番組は非常にユーモラスで、道路安全を考える仲間の皆さんにぜひ視聴をおすすめします。

秦 L の音声提示はとてもユーモラスですが、結局止まりました。しかし、漢と宋は止まらず、海鸥が一番面白く、走って止まるということです。ハードウェアとソフトウェアが同じでも、AIは異なる選択をする可能性があります。

自動運転はまだクラクションを鳴らすことがあります(問界は前方車両にハイビームを自動で点滅させることもあります)。

零跑はさらにすごく、車の底からモデルトラックを直接吹き飛ばします。![]()

共通の特徴:

-

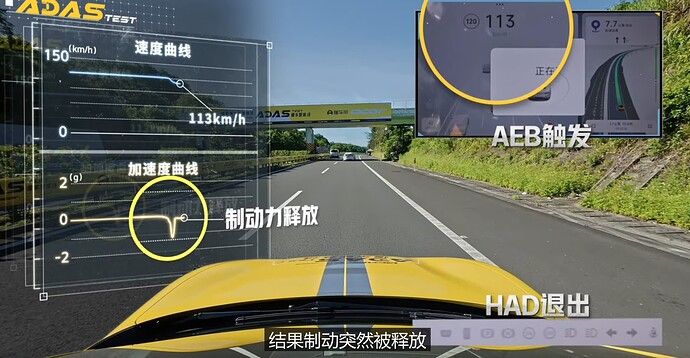

事故が起きる1秒前に「自動運転が終了しました、ハンドルを取ってください」と提示するのが好きで、こうすれば事故が起きても最後はドライバー自身の衝突だと言えます。

-

衝突するくらいなら、少しでも保守的に事前に減速/ブレーキすることはしません。多くの車は夜間でも130km/hで自動運転クルーズを続けます。

見終わって、私の見解は以前と同じで、あらゆる形態の自動運転は禁止すべきです。

もしかしたら、現行のモデルはまだ不完全で、訓練データが不足しているので、技術が成熟すれば良くなると言う人もいるかもしれません。

では、より保守的なルールを持つ自動運転は信頼できるでしょうか?

私はやはりだめだと思います。

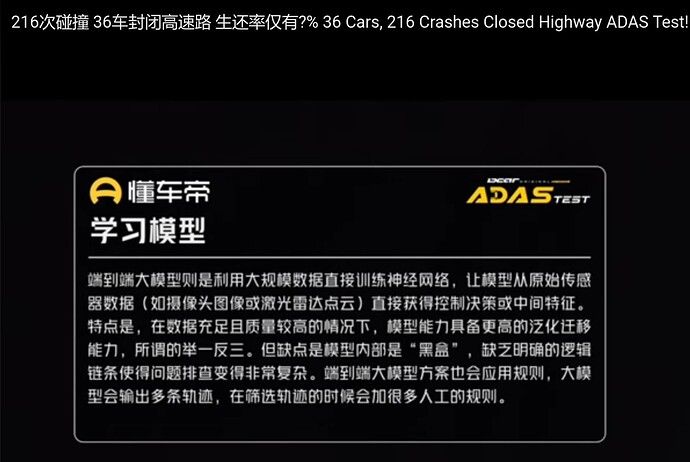

- 学習ベースの方法:訓練データの質:量、シーンの多様性、低確率だが高損害のシーンが存在すること

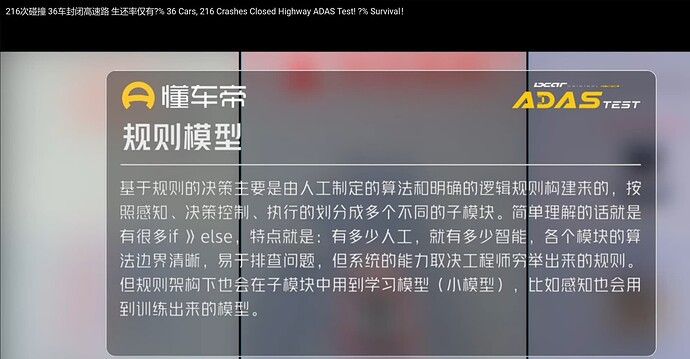

- ルールベースの方法:人間にはバイアスがあり、すべてのルールを列挙することが難しく、具体的なシーンごとの分析も困難で、ルールが多すぎて結合すると予期しない結果を招くことがあります:

例えば、想像可能性は実生活の状況における確率評価に重要な役割を果たします。たとえば、冒険遠征に伴うリスクは、遠征が対処できない事態を想像することで評価されます。そのような困難が多数鮮明に描かれると、遠征は非常に危険に見えることがありますが、災害を想像しやすいことが実際の発生確率を反映しているわけではありません。逆に、ある事業に伴うリスクは、可能性のある危険が想像しにくい、あるいは単に思い浮かばない場合、過小評価されることがあります。(Thinking, Fast and Slowより)

視力が悪い人や経験不足の人、反応が遅い人など、たくさんのひどいドライバーがAIよりも運転が下手です。しかし、これらの人は運転しない方が良いと思います ![]()